[解決済み】機械学習モデルの損失と精度の解釈の仕方【終了しました

質問

TheanoやTensorflowでニューラルネットワークを学習させると、エポックごとに"loss"という変数が報告されます。

この変数をどのように解釈すればよいのでしょうか?損失が大きい方が良いのか悪いのか、あるいは私のニューラルネットワークの最終的な性能(精度)に対してどのような意味を持つのでしょうか?

どのように解決するのですか?

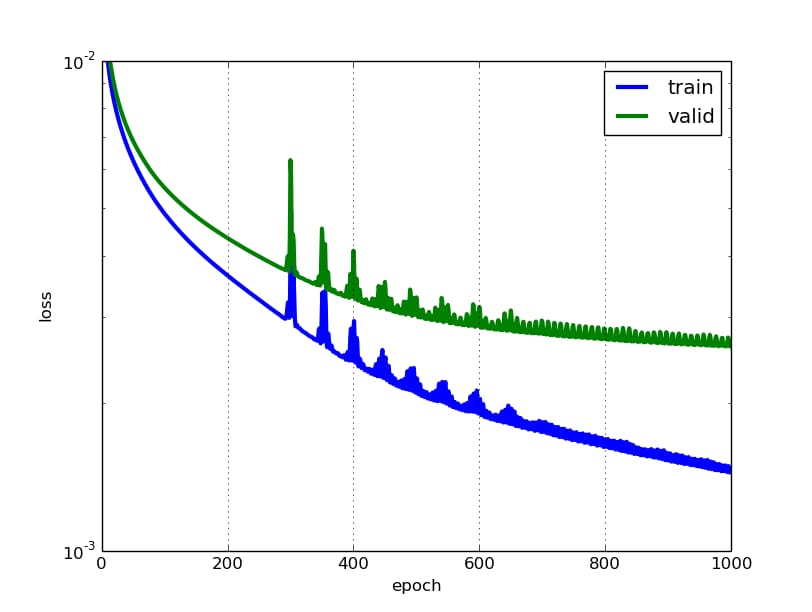

が低いほど の損失が発生します。 は、(モデルが学習データにオーバーフィットしていない限り)優れたモデルであることを意味します。損失は トレーニング と バリデーション であり、その相互作用は、これらの2つのセットに対してモデルがどの程度うまくいっているかを示している。精度とは異なり、損失はパーセンテージではありません。トレーニングセットや検証セットの各例で発生した誤差の合計です。

ニューラルネットワークの場合、損失は通常 負の対数尤度 と 残留二乗和 は、それぞれ分類と回帰のためのものです。そうすると当然、学習モデルにおける主目的は、ニューラルネットワークにおけるバックプロパゲーションのような様々な最適化手法によってウエイトベクトルの値を変化させ、モデルのパラメータに対する損失関数の値を小さく(最小化)することである。

損失値とは、あるモデルが最適化を繰り返すたびに、その挙動がどの程度良好であるか、あるいは不良であるかを意味します。理想的には、1回または数回の反復の後、損失が減少することが期待されます。

その 精度 は通常、モデルのパラメータが学習され固定され、学習が行われなくなった後に決定される。そして、テストサンプルをモデルに与え、真のターゲットと比較した上で、モデルが犯したミス(ゼロ・ワン・ロス)の数を記録する。そして、誤判定の割合を計算する。

例えば、テストサンプルの数が1000個で、モデルがそのうちの952個を正しく分類した場合、モデルの精度は95.2%となります。

また、損失額を減らす一方で、いくつかの微妙な点があります。例えば、以下のような問題にぶつかることがあります。

オーバーフィット

この場合、モデルは学習例を記憶してしまい、テストセットでは有効でなくなります。また,オーバーフィッティングは,学習用モデルを使用しない場合にも発生します.

正則化

非常に複雑なモデルを使用している場合(自由パラメータ数

W

が大きい)、あるいはデータ点数

N

が非常に少ない。

関連

-

[解決済み】TensorFlowでtf.gradientsが動作する方法

-

[解決済み】Keras - KerasRegressorを使用して予測を実行する方法は?

-

[解決済み] Kerasにおける "Flatten "の役割とは?

-

[解決済み] RuntimeError: 次元が範囲外([-1, 0]の範囲にあると期待されたが、1が得られた)

-

[解決済み] エアフローとKubeflowパイプラインの違いは何ですか?

-

[解決済み】線形回帰とロジスティック回帰の違いは何ですか?[クローズド]

-

[解決済み】教師あり学習と教師なし学習の違いは何ですか?[終了しました]

-

[解決済み】機械学習モデルの損失と精度の解釈の仕方【終了しました

-

[解決済み] Kerasにおける多対一および多対多のLSTMの例

-

[解決済み] Diablo 2をプレイするための人工ニューラルネットワークを視覚的に学習させる方法とは?

最新

-

nginxです。[emerg] 0.0.0.0:80 への bind() に失敗しました (98: アドレスは既に使用中です)

-

htmlページでギリシャ文字を使うには

-

ピュアhtml+cssでの要素読み込み効果

-

純粋なhtml + cssで五輪を実現するサンプルコード

-

ナビゲーションバー・ドロップダウンメニューのHTML+CSSサンプルコード

-

タイピング効果を実現するピュアhtml+css

-

htmlの選択ボックスのプレースホルダー作成に関する質問

-

html css3 伸縮しない 画像表示効果

-

トップナビゲーションバーメニュー作成用HTML+CSS

-

html+css 実装 サイバーパンク風ボタン

おすすめ

-

[解決済み] PyTorchのバックワード関数

-

[解決済み] コスト関数、線形回帰、シータをハードコーディングしないようにする。オクターブ

-

[解決済み] サポートベクターマシンに対する人工ニューラルネットワークの優位性は何ですか?[終了しました]

-

[解決済み】線形回帰とロジスティック回帰の違いは何ですか?[クローズド]

-

[解決済み】データセットをトレーニングセットとバリデーションセットに分割する方法には法則性があるのでしょうか?[クローズド]

-

[解決済み] なぜ人工ニューラルネットワークの入力を正規化する必要があるのですか?[クローズド]

-

[解決済み] Diablo 2をプレイするための人工ニューラルネットワークを視覚的に学習させる方法とは?

-

[解決済み] Appleはどのように電子メールの日付、時間、アドレスを見つけるのですか?

-

[解決済み] 期待値最大化手法の直感的な説明とは?[クローズド]

-

[解決済み] なぜFメジャーはPrecisionとRecallの算術平均ではなく調和平均なのですか?